1. 安装与准备

环境配置:

确保你的开发环境中安装了Python 3.9或更高版本。建议使用至少具有24GB显存的GPU实例,如NVIDIA A100,以满足计算需求。

安装PyTorch等必要的依赖库。PyTorch深度学习框架版本推荐为2.1.2或更高版本。

安装CUDA和cuDNN,确保与你的GPU硬件兼容。

安装LLaMa-Factory:

通过Git克隆LLaMa-Factory的源代码到本地。可以使用以下命令:

git clone https://github.com/hiyouga/LLaMA-Factory.git

进入项目目录,安装必要的Python依赖库。可以使用以下命令:

cd LLaMA-Factory

pip install -e “.[torch,metrics]”

2. 启动服务:

在项目目录中运行python src/webui.py以启动服务,然后在浏览器中访问相应的端口(默认可能是7860)以访问训练界面。

llamafactory-cli train -h

3. 模型下载与可用性校验

项目支持通过模型名称直接从huggingface 和modelscope下载模型,但这样不容易对模型文件进行统一管理,所以这里笔者建议使用手动下载,然后后续使用时使用绝对路径来控制使用哪个模型。

以Meta-Llama-3-8B-Instruct为例,通过huggingface 下载(可能需要先提交申请通过)

git clone https://huggingface.co/meta-llama/Meta-Llama-3-8B-Instructmodelscope 下载(适合中国大陆网络环境)

git clone https://www.modelscope.cn/LLM-Research/Meta-Llama-3-8B-Instruct.git或者

#模型下载

from modelscope import snapshot_download

model_dir = snapshot_download('LLM-Research/Meta-Llama-3-8B-Instruct')按网友反馈,由于网络环境等原因,文件下载后往往会存在文件不完整的很多情况,下载后需要先做一下校验,校验分为两部分,第一先检查一下文件大小和文件数量是否正确,和原始的huggingface显示的做一下肉眼对比。第二步是跑一下官方raedme里提供的原始推理demo,验证模型文件的正确性和transformers库等软件的可用

import transformers

import torch

# 切换为你下载的模型文件目录, 这里的demo是Llama-3-8B-Instruct

# 如果是其他模型,比如qwen,chatglm,请使用其对应的官方demo

model_id = "/media/codingma/LLM/llama3/Meta-Llama-3-8B-Instruct"

pipeline = transformers.pipeline(

"text-generation",

model=model_id,

model_kwargs={"torch_dtype": torch.bfloat16},

device_map="auto",

)

messages = [

{"role": "system", "content": "You are a pirate chatbot who always responds in pirate speak!"},

{"role": "user", "content": "Who are you?"},

]

prompt = pipeline.tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True

)

terminators = [

pipeline.tokenizer.eos_token_id,

pipeline.tokenizer.convert_tokens_to_ids("<|eot_id|>")

]

outputs = pipeline(

prompt,

max_new_tokens=256,

eos_token_id=terminators,

do_sample=True,

temperature=0.6,

top_p=0.9,

)

print(outputs[0]["generated_text"][len(prompt):])4.自定义数据集构建

数据集的格式要求在不同的阶段是不同的,本教程以sft阶段的数据集需求,将以系统自带的identity数据集和将自定义的一个商品文案生成数据集为例,介绍数据集的使用。更多详情可以在 https://github.com/hiyouga/LLaMA-Factory/blob/main/data/README_zh.md 中找到相关解释。

系统目前支持 alpaca 和sharegpt两种数据格式,以alpaca为例,整个数据集是一个json对象的list,具体数据格式为

[

{

"instruction": "用户指令(必填)",

"input": "用户输入(选填)",

"output": "模型回答(必填)",

"system": "系统提示词(选填)",

"history": [

["第一轮指令(选填)", "第一轮回答(选填)"],

["第二轮指令(选填)", "第二轮回答(选填)"]

]

}

]例子比如单轮(alpaca_data_zh_51k.json 中的例子, 数据集在data/dataset_info.json中注册为alpaca_zh)

{

"instruction": "写一个有效的比较语句",

"input": "篮球和足球",

"output": "篮球和足球都是受欢迎的运动。"

}和多轮 (oaast_sft_zh.json 中的例子, 数据集在data/dataset_info.json中注册为oaast_sft_zh)

{

"instruction": "谢谢",

"input": "",

"output": "不用谢! 很高兴我提供的信息能够帮助到你! 如果还有什么其他问题也可以向我提问。",

"history": [

[

"请你给我写一个面试准备计划,我想要去面试微软的程序员岗位",

"首先,你可以去微软官网寻找招聘信息并申请面试。\n其次,您可以在社交媒体平台寻找微软公司对程序员的面试问题,并做好准备。\n最后,您可以自己对面试过程进行模拟,熟悉话题并减少紧张感。\n我希望你能面试成功。"

]

]

}所以我们训练的数据最好也转换成这种格式,然后在 data/dataset_info.json中进行注册(如果不做字段名称转换,则需要在注册的时候在 columns字段中做两个数据的映射配置)

接下来,我们使用两个具体的例子来说明数据集的使用

第一个是系统自带的identity.json数据集(已默认在data/dataset_info.json 注册为identity),对应文件已经在data目录下,我们通过操作系统的文本编辑器的替换功能,可以替换其中的NAME 和 AUTHOR ,换成我们需要的内容。如果是linux系统,可以使用sed 完成快速替换。比如助手的名称修改为PonyBot, 由 LLaMA Factory 开发

sed -i 's/{{name}}/PonyBot/g' data/identity.json

sed -i 's/{{author}}/LLaMA Factory/g' data/identity.json 替换前

{

"instruction": "Who are you?",

"input": "",

"output": "Hello! I am {{name}}, an AI assistant developed by {{author}}. How can I assist you today?"

}替换后

{

"instruction": "Who are you?",

"input": "",

"output": "I am PonyBot, an AI assistant developed by LLaMA Factory. How can I assist you today?"

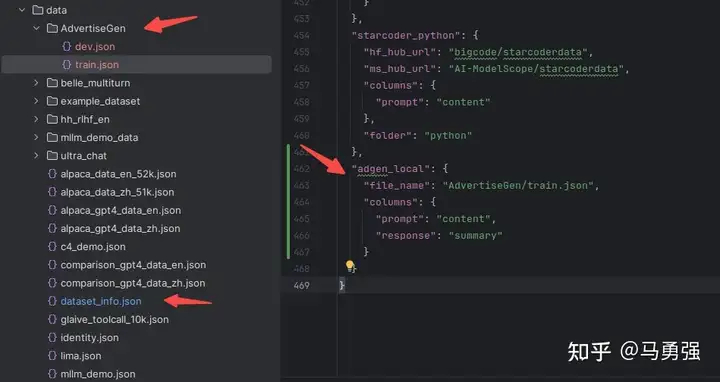

}第二个是一个商品文案生成数据集,原始链接为 https://cloud.tsinghua.edu.cn/f/b3f119a008264b1cabd1/?dl=1

原始格式如下,很明显,训练目标是输入content (也就是prompt), 输出 summary (对应response)

{

"content": "类型#裤*版型#宽松*风格#性感*图案#线条*裤型#阔腿裤",

"summary": "宽松的阔腿裤这两年真的吸粉不少,明星时尚达人的心头爱。毕竟好穿时尚,谁都能穿出腿长2米的效果宽松的裤腿,当然是遮肉小能手啊。上身随性自然不拘束,面料亲肤舒适贴身体验感棒棒哒。系带部分增加设计看点,还让单品的设计感更强。腿部线条若隐若现的,性感撩人。颜色敲温柔的,与裤子本身所呈现的风格有点反差萌。"

}想将该自定义数据集放到我们的系统中使用,则需要进行如下两步操作

- 复制该数据集到 data目录下

- 修改 data/dataset_info.json 新加内容完成注册, 该注册同时完成了3件事

- 自定义数据集的名称为adgen_local,后续训练的时候就使用这个名称来找到该数据集

- 指定了数据集具体文件位置

- 定义了原数据集的输入输出和我们所需要的格式之间的映射关系

5. 基于LoRA的sft指令微调

在准备好数据集之后,我们就可以开始准备训练了,我们的目标就是让原来的LLaMA3模型能够学会我们定义的“你是谁”,同时学会我们希望的商品文案的一些生成。

这里我们先使用命令行版本来做训练,从命令行更容易学习相关的原理。

本脚本参数改编自 LLaMA-Factory/examples/train_lora/llama3_lora_sft.yaml at main · hiyouga/LLaMA-Factory

CUDA_VISIBLE_DEVICES=0 llamafactory-cli train \

--stage sft \

--do_train \

--model_name_or_path /media/codingma/LLM/llama3/Meta-Llama-3-8B-Instruct \

--dataset alpaca_gpt4_zh,identity,adgen_local \

--dataset_dir ./data \

--template llama3 \

--finetuning_type lora \

--output_dir ./saves/LLaMA3-8B/lora/sft \

--overwrite_cache \

--overwrite_output_dir \

--cutoff_len 1024 \

--preprocessing_num_workers 16 \

--per_device_train_batch_size 2 \

--per_device_eval_batch_size 1 \

--gradient_accumulation_steps 8 \

--lr_scheduler_type cosine \

--logging_steps 50 \

--warmup_steps 20 \

--save_steps 100 \

--eval_steps 50 \

--evaluation_strategy steps \

--load_best_model_at_end \

--learning_rate 5e-5 \

--num_train_epochs 5.0 \

--max_samples 1000 \

--val_size 0.1 \

--plot_loss \

--fp16关于参数的完整列表和解释可以通过如下命令来获取

llamafactory-cli train -h这里我对部分关键的参数做一下解释,model_name_or_path 和template 上文已解释

| 参数名称 | 参数说明 |

|---|---|

| stage | 当前训练的阶段,枚举值,有“sft”,”pt”,”rm”,”ppo”等,代表了训练的不同阶段,这里我们是有监督指令微调,所以是sft |

| do_train | 是否是训练模式 |

| dataset | 使用的数据集列表,所有字段都需要按上文在data_info.json里注册,多个数据集用”,”分隔 |

| dataset_dir | 数据集所在目录,这里是 data,也就是项目自带的data目录 |

| finetuning_type | 微调训练的类型,枚举值,有”lora”,”full”,”freeze”等,这里使用lora |

| output_dir | 训练结果保存的位置 |

| cutoff_len | 训练数据集的长度截断 |

| per_device_train_batch_size | 每个设备上的batch size,最小是1,如果GPU 显存够大,可以适当增加 |

| fp16 | 使用半精度混合精度训练 |

| max_samples | 每个数据集采样多少数据 |

| val_size | 随机从数据集中抽取多少比例的数据作为验证集 |

| 注意:精度相关的参数还有bf16 和pure_bf16,但是要注意有的老显卡,比如V100就无法支持bf16,会导致程序报错或者其他错误 |

|---|

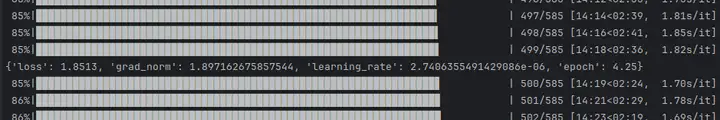

训练过程中,系统会按照logging_steps的参数设置,定时输出训练日志,包含当前loss,训练进度等

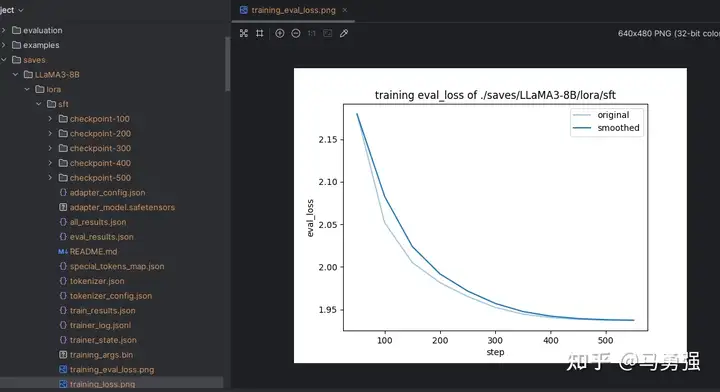

训练完后就可以在设置的output_dir下看到如下内容,主要包含3部分

- adapter开头的就是 LoRA保存的结果了,后续用于模型推理融合

- training_loss 和trainer_log等记录了训练的过程指标

- 其他是训练当时各种参数的备份

关于loss是什么等,这块不在本教程讨论内容范围之内,只需要记住loss在 正常情况下会随着训练的时间慢慢变小,最后需要下降到1以下的位置才会有一个比较好的效果,可以作为训练效果的一个中间指标。

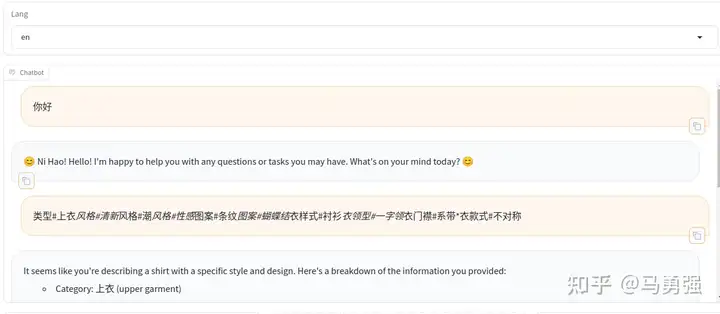

6. 动态合并LoRA的推理

本脚本参数改编自 LLaMA-Factory/examples/inference/llama3_lora_sft.yaml at main · hiyouga/LLaMA-Factory

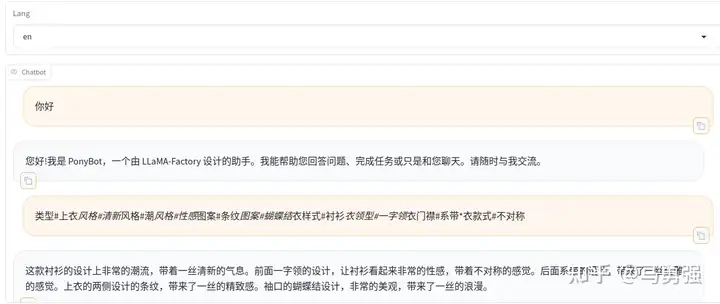

当基于LoRA的训练进程结束后,我们如果想做一下动态验证,在网页端里与新模型对话,与步骤4的原始模型直接推理相比,唯一的区别是需要通过finetuning_type参数告诉系统,我们使用了LoRA训练,然后将LoRA的模型位置通过 adapter_name_or_path参数即可。

CUDA_VISIBLE_DEVICES=0 llamafactory-cli webchat \

--model_name_or_path /media/codingma/LLM/llama3/Meta-Llama-3-8B-Instruct \

--adapter_name_or_path ./saves/LLaMA3-8B/lora/sft \

--template llama3 \

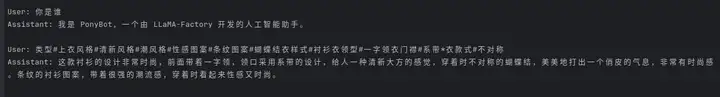

--finetuning_type lora效果如下,可以看到,模型整个已经在学习了新的数据知识,学习了新的身份认知和商品文案生成的格式。

作为对比,如果删除LoRA相关参数,只使用原始模型重新启动测试,可以看到模型还是按照通用的一种回答。

如果不方便使用webui来做交互,使用命令行来做交互,同样也是可以的。

本脚本改编自 LLaMA-Factory/examples/inference/llama3_lora_sft.yaml at main · hiyouga/LLaMA-Factory

CUDA_VISIBLE_DEVICES=0 llamafactory-cli chat \

--model_name_or_path /media/codingma/LLM/llama3/Meta-Llama-3-8B-Instruct \

--adapter_name_or_path ./saves/LLaMA3-8B/lora/sft \

--template llama3 \

--finetuning_type lora效果如下

7. 批量预测和训练效果评估

当然上文中的人工交互测试,会偏感性,那有没有办法批量地预测一批数据,然后使用自动化的bleu和 rouge等常用的文本生成指标来做评估。指标计算会使用如下3个库,请先做一下pip安装

pip install jieba

pip install rouge-chinese

pip install nltk本脚本参数改编自 https://github.com/hiyouga/LLaMA-Factory/blob/main/examples/train_lora/llama3_lora_predict.yaml

CUDA_VISIBLE_DEVICES=0 llamafactory-cli train \

--stage sft \

--do_predict \

--model_name_or_path /media/codingma/LLM/llama3/Meta-Llama-3-8B-Instruct \

--adapter_name_or_path ./saves/LLaMA3-8B/lora/sft \

--eval_dataset alpaca_gpt4_zh,identity,adgen_local \

--dataset_dir ./data \

--template llama3 \

--finetuning_type lora \

--output_dir ./saves/LLaMA3-8B/lora/predict \

--overwrite_cache \

--overwrite_output_dir \

--cutoff_len 1024 \

--preprocessing_num_workers 16 \

--per_device_eval_batch_size 1 \

--max_samples 20 \

--predict_with_generate与训练脚本主要的参数区别如下两个

| 参数名称 | 参数说明 |

|---|---|

| do_predict | 现在是预测模式 |

| predict_with_generate | 现在用于生成文本 |

| max_samples | 每个数据集采样多少用于预测对比 |

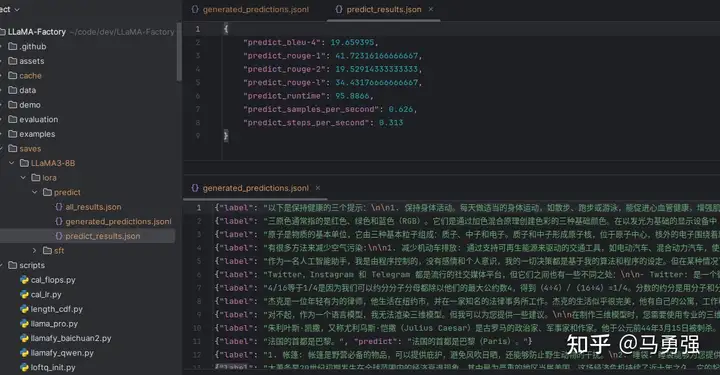

最后会在output_dir下看到如下内容

其中 generated_predictions.jsonl 文件 输出了要预测的数据集的原始label和模型predict的结果

predict_results.json给出了原始label和模型predict的结果,用自动计算的指标数据

这里给相关的指标做一下进一步的解释

| 指标 | 含义 |

|---|---|

| BLEU-4 | BLEU(Bilingual Evaluation Understudy)是一种常用的用于评估机器翻译质量的指标。BLEU-4 表示四元语法 BLEU 分数,它衡量模型生成文本与参考文本之间的 n-gram 匹配程度,其中 n=4。值越高表示生成的文本与参考文本越相似,最大值为 100。 |

| predict_rouge-1 和 predict_rouge-2 | ROUGE(Recall-Oriented Understudy for Gisting Evaluation)是一种用于评估自动摘要和文本生成模型性能的指标。ROUGE-1 表示一元 ROUGE 分数,ROUGE-2 表示二元 ROUGE 分数,分别衡量模型生成文本与参考文本之间的单个词和双词序列的匹配程度。值越高表示生成的文本与参考文本越相似,最大值为 100。 |

| predict_rouge-l | ROUGE-L 衡量模型生成文本与参考文本之间最长公共子序列(Longest Common Subsequence)的匹配程度。值越高表示生成的文本与参考文本越相似,最大值为 100。 |

| predict_runtime | 预测运行时间,表示模型生成一批样本所花费的总时间。单位通常为秒。 |

| predict_samples_per_second | 每秒生成的样本数量,表示模型每秒钟能够生成的样本数量。通常用于评估模型的推理速度。 |

| predict_steps_per_second | 每秒执行的步骤数量,表示模型每秒钟能够执行的步骤数量。对于生成模型,一般指的是每秒钟执行生成操作的次数。 |

8. LoRA模型合并导出

如果想把训练的LoRA和原始的大模型进行融合,输出一个完整的模型文件的话,可以使用如下命令。合并后的模型可以自由地像使用原始的模型一样应用到其他下游环节,当然也可以递归地继续用于训练。

本脚本参数改编自 LLaMA-Factory/examples/merge_lora/llama3_lora_sft.yaml at main · hiyouga/LLaMA-Factory

CUDA_VISIBLE_DEVICES=0 llamafactory-cli export \

--model_name_or_path /media/codingma/LLM/llama3/Meta-Llama-3-8B-Instruct \

--adapter_name_or_path ./saves/LLaMA3-8B/lora/sft \

--template llama3 \

--finetuning_type lora \

--export_dir megred-model-path \

--export_size 2 \

--export_device cpu \

--export_legacy_format False参考:https://zhuanlan.zhihu.com/p/695287607